Cos’è il Web Scraping?

Scopri cos'è il web scraping e come utilizzare Screaming Frog per reperire informazioni dalla serp.

Web Scraping

Il concetto di web scraping affonda le radici nell’inglese “to scrape” e si configura come una metodologia particolare volta alla raccolta di dati e informazioni direttamente dalle pagine web o dalla serp per catalogarli e archiviarli in un database.

In alcuni casi, ancora molto frequenti, il web scraping viene utilizzato per raccogliere nomi, cognomi e dati sensibili da utilizzare come database per il marketing ma questa attività è da considerarsi illegale.

In altri casi questa attività può essere utilizzata per campagne di phishing, furti d’identità o violazioni del diritto d’autore.

Nonostante questi eccessi nel suo utilizzo il Web Scraping non è considerato illegale e permette di reperire dati molto importanti nelle analisi SEO e in generale per tutto il Digital Marketing.

Web Scraping e la Legalità

Il web scraping è una tecnica di estrazione automatizzata di dati da siti web utilizzando software o script appositi. Questo processo permette di raccogliere informazioni strutturate, come testi, immagini o altri dati disponibili pubblicamente, per poi elaborarle secondo necessità specifiche.

Tecnologie e Metodi

I metodi principali per il web scraping includono:

- Parsing HTML: utilizzo di librerie come Beautiful Soup in Python per analizzare il codice HTML di una pagina.

- Automazione del browser: strumenti come Selenium che simulano un utente umano per navigare e interagire con le pagine.

- API pubbliche: molti siti offrono API (Application Programming Interfaces) che consentono di accedere legalmente ai dati in un formato strutturato.

Applicazioni del Web Scraping

Le tecniche comunemente impiegate per eseguire il web scraping comprendono:

- Analisi di mercato: Le aziende possono monitorare i prezzi dei concorrenti e le recensioni dei consumatori.

- Ricerca accademica: Raccolta di grandi volumi di dati per analisi statistiche.

- Automatizzazione: Riduzione dei tempi necessari per acquisire manualmente dati da diverse fonti.

Casi d’Uso Reali

Un esempio concreto è l’uso del “crawling web” nel settore dell’e-commerce per aggiornare dinamicamente i prezzi in base ai concorrenti. Allo stesso modo, piattaforme di monitoraggio come quelle che aggregano offerte immobiliari sfruttano il web scraping per mantenere aggiornata la propria base dati.

Aspetti Legali del Web Scraping

Il web scraping, nonostante la sua utilità, solleva diverse questioni legali. Comprendere e rispettare le normative è essenziale per evitare conflitti e proteggere le parti coinvolte.

Ad esempio, in alcune giurisdizioni, la pratica del web scraping è considerata una violazione delle leggi sulla proprietà intellettuale o sui contratti, in particolare quando viola i termini di servizio di un sito web. Inoltre, l’accesso non autorizzato a sistemi informatici può essere interpretato come un reato ai sensi di leggi come il Computer Fraud and Abuse Act (CFAA) negli Stati Uniti.

Il GDPR e il Web Scraping

Il Regolamento Generale sulla Protezione dei Dati (GDPR), in vigore nell’Unione Europea dal 2018, disciplina la raccolta e l’uso dei dati personali. Secondo il GDPR, qualsiasi dato che possa identificare una persona è considerato “personale” e soggetto a rigide normative. Ciò include informazioni come nomi, indirizzi email, numeri di telefono e indirizzi IP.

Implicazioni per il Web Scraping:

- Base Giuridica per la Raccolta Dati: Le aziende devono identificare una base giuridica valida per la raccolta di dati personali. Ad esempio, possono raccogliere dati solo con il consenso esplicito dell’interessato (Articolo 6 del GDPR) o per perseguire un interesse legittimo che non prevarichi i diritti fondamentali della persona.

- Trasparenza e Informativa: Gli utenti devono essere informati chiaramente su come i loro dati verranno utilizzati. Questo richiede l’inserimento di informative sulla privacy che descrivano le finalità e i metodi della raccolta.

- Minimizzazione dei Dati: Il GDPR impone la raccolta del solo minimo necessario di dati per raggiungere uno scopo legittimo (Principio di minimizzazione).

- Sicurezza dei Dati: I dati raccolti devono essere protetti da accessi non autorizzati attraverso adeguate misure tecniche e organizzative (Articolo 32).

Esempi Pratici

Un caso noto che evidenzia le problematiche legate al GDPR e al crawling web è stato quello di aziende che utilizzano scraping per raccogliere indirizzi email o profili LinkedIn senza consenso. Questi comportamenti hanno portato a sanzioni amministrative significative in base agli articoli 83 e 84 del GDPR, che prevedono multe fino a 20 milioni di euro o il 4% del fatturato globale annuo.

Le aziende che operano nel campo del web scraping devono anche considerare l’applicabilità del diritto alla cancellazione (Articolo 17), noto anche come “diritto all’oblio”, che garantisce agli utenti la possibilità di richiedere la rimozione dei propri dati da database.

Proprietà Intellettuale e Web Scraping

Le leggi sulla proprietà intellettuale, inclusi i diritti d’autore, si applicano anche ai contenuti online.

Aspetti Legali:

- Contenuti protetti da copyright: La copia di testi, immagini o altri elementi protetti è vietata senza autorizzazione, ai sensi delle normative sul diritto d’autore. Questo si applica anche ai contenuti pubblicamente accessibili ma soggetti a copyright, come articoli di giornale, immagini o database protetti da diritti di compilazione.

- Termini di servizio: La maggior parte dei siti include clausole che vietano il web scraping nei propri termini di utilizzo. Ignorare tali restrizioni può portare a contenziosi legali, come dimostrato in diversi casi internazionali.

Casi Noti

Un caso emblematico è stato il contenzioso tra LinkedIn e HiQ Labs, dove LinkedIn ha cercato di impedire a HiQ di raccogliere dati pubblici dai profili degli utenti. La disputa si è concentrata su due temi chiave: la violazione dei termini di servizio di LinkedIn e il potenziale conflitto con la libera concorrenza. Sebbene inizialmente HiQ abbia ottenuto un verdetto favorevole, il caso ha sottolineato la complessità legale del web scraping.

Un altro esempio significativo è rappresentato dalle controversie legali riguardanti l’uso di immagini protette da copyright attraverso scraping. Un caso celebre è quello della Getty Images, che ha intrapreso azioni legali contro piattaforme che utilizzano software di scraping per acquisire e redistribuire immagini senza licenza.

Conformità e Soluzioni

Per evitare violazioni delle leggi sulla proprietà intellettuale:

- Verificare i diritti di utilizzo: Prima di utilizzare dati raccolti tramite scraping, accertarsi che non siano protetti da copyright o da altre normative sulla proprietà intellettuale.

- Richiedere licenze: Dove applicabile, ottenere licenze o autorizzazioni per l’utilizzo di contenuti protetti.

- Utilizzare fonti open data: Privilegiare dati e contenuti rilasciati sotto licenze aperte (come Creative Commons), che ne consentano l’uso legale e gratuito.

Affrontare le questioni legali relative alla proprietà intellettuale è fondamentale per evitare contenziosi e salvaguardare la reputazione aziendale.

Best Practices per un Data Extraction Legalmente Conforme

Rispettare le normative è cruciale per evitare problematiche legali e garantire un uso etico del web scraping e del data privacy.

Strategie Consigliate

- Ottenere Permessi: Contattare i proprietari dei siti web per ottenere l’autorizzazione esplicita prima di raccogliere dati.

- Rispettare le Privacy Policy: Consultare e conformarsi alle politiche di privacy del sito.

- Utilizzare API: Preferire l’utilizzo di API ufficiali rispetto al scraping diretto del contenuto HTML.

- Anonimizzazione dei dati: Eliminare qualsiasi informazione personale dai dati raccolti, ove possibile.

Redazione di Policy Aziendali

Le aziende che praticano il web scraping dovrebbero:

- Documentare chiaramente le proprie procedure di raccolta dati.

- Fornire informazioni dettagliate sulle misure adottate per garantire la conformità.

Digital Marketing e Scraping

Comprese le potenzialità e i rischi dello “Crawling web selvaggio” vediamo le sue applicazioni nella Seo e nel digital marketing in generale e come sfruttarlo con un software per web scraping come Screaming Frog.

Dopo anni in cui questa attività è stata subordinata a conoscenze informatiche di livello medio alto, ora come ora esistono strumenti no-code che permettono risultati notevoli in termini di estrazione dati.

Alla base dell’Ethical web Scraping c’è uno standard denominato XPath che permette di localizzare e, di conseguenza gestire i diversi nodi di un documento Html in modo alquanto agevole.

Web Scraping e SEO

Il web scraping offre diversi vantaggi per l’ottimizzazione sui Motori di Ricerca (SEO):

- Ricerca di parole chiave: Il web scraping consente di raccogliere un’ampia varietà di dati, inclusi dati di parole chiave utilizzati dai concorrenti o presenti nelle pagine web dei siti web più rilevanti per un determinato settore. Queste informazioni possono essere utilizzate per identificare nuove opportunità di parole chiave e migliorare la strategia di SEO (analisi heading, meta tag etc.).

- Monitoraggio dei concorrenti: attraverso il web scraping è possibile monitorare costantemente le attività dei concorrenti, inclusi cambiamenti nelle loro strategie di SEO, nuovi contenuti pubblicati, aggiornamenti algoritmici di Google e altro ancora. Queste informazioni possono essere preziose per adattare e ottimizzare la propria strategia di SEO.

- Aggiornamento dei dati: un uso consapevole di questa attività consente di mantenere aggiornati i dati utilizzati per l’ottimizzazione dei motori di ricerca. Ad esempio, è possibile monitorare costantemente i risultati di ricerca e gli aggiornamenti di classifica per determinate parole chiave, nonché raccogliere dati su nuove tendenze di ricerca e comportamenti degli utenti.

- Analisi dei backlink: Il web scraping può essere utilizzato per estrarre informazioni sui backlink provenienti da siti web rilevanti o concorrenti. Questi dati possono essere analizzati per identificare nuove opportunità di link building e valutare la qualità dei backlink esistenti (servizi come Semrush/Seozoom).

- Scraping di contenuti: Se utilizzato in modo etico e conforme alle normative, il web scraping può consentire di raccogliere contenuti rilevanti da altre fonti online per arricchire il proprio sito web con informazioni aggiuntive o per creare nuovi contenuti di alta qualità integrando le diverse fonti.

In sintesi, il web scraping offre agli specialisti SEO una serie di strumenti e dati utili per ottimizzare e migliorare le prestazioni dei siti web nei motori di ricerca. Tuttavia, è importante utilizzare queste informazioni in modo responsabile e rispettoso delle normative vigenti per evitare controversie legali o penalizzazioni da parte dei motori di ricerca.

Screaming Frog e Web Scraping

Compresa l’importanza di questa attività vediamo come sfruttare un “data scraping tools” come Screaming Frog, per estrarre informazioni preziose per migliorare la nostra strategia di marketing digitale.

Con il SEO Spider potrai affinare la tua capacità di raccogliere dati da pagine web in modo rapido ed efficiente per analisi del tuo sito web o elaborare analisi comparative dei competitors anche molto avanzate.

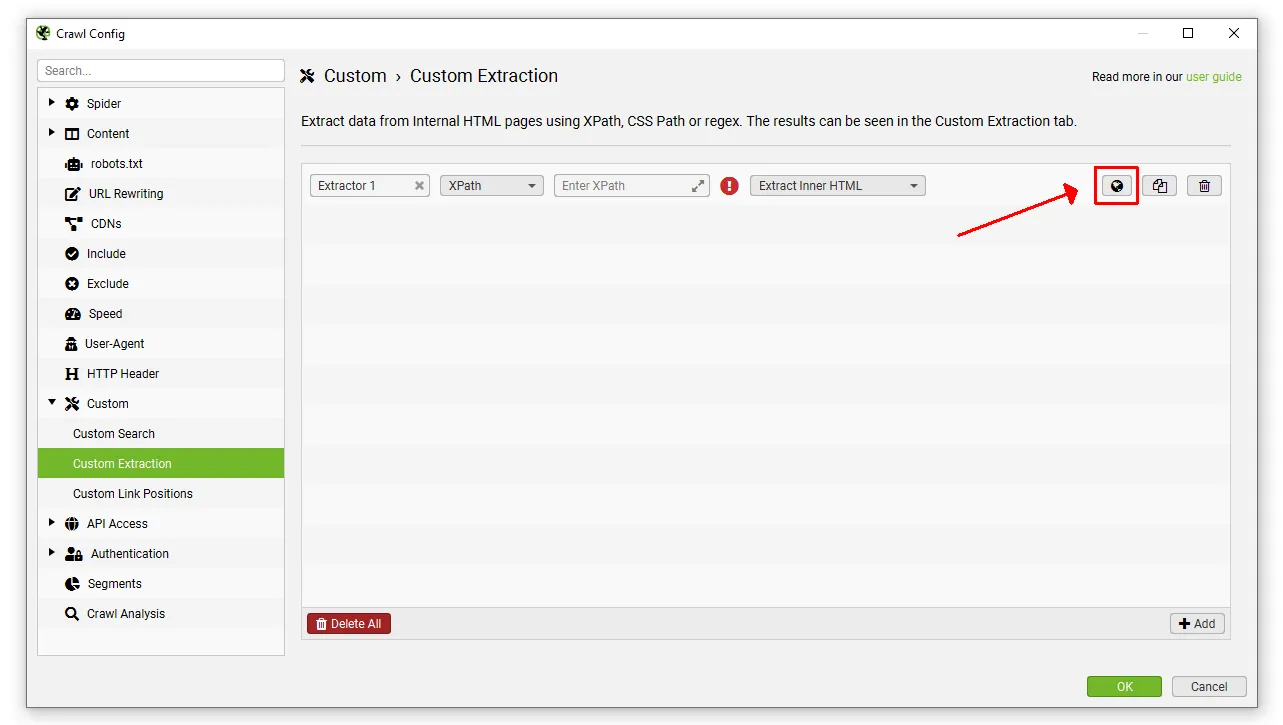

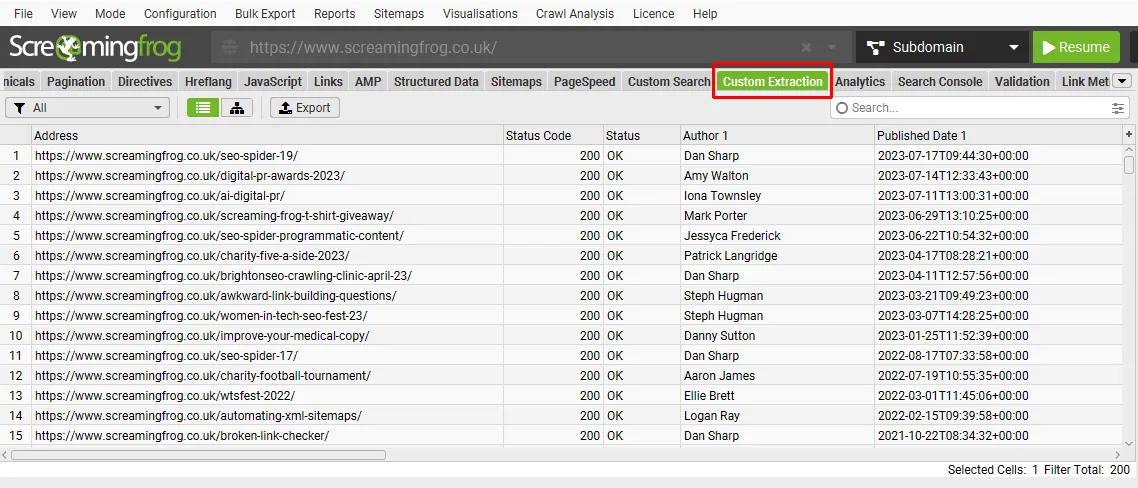

Attraverso l’XPath e la Custom Extraction le tue analisi non saranno più le stesse. In più, dalla versione 19 del web crawler la funzione di “Scraping personalizzato” è diventata ancora più semplice ed intuitiva e non servirà alcuna conoscenza pregressa per ottenere i risultati sperati.

Una volta entrato nella funzione sarà sufficiente cliccare su “add” in basso a destra ed inserire l’espressione di scraping.

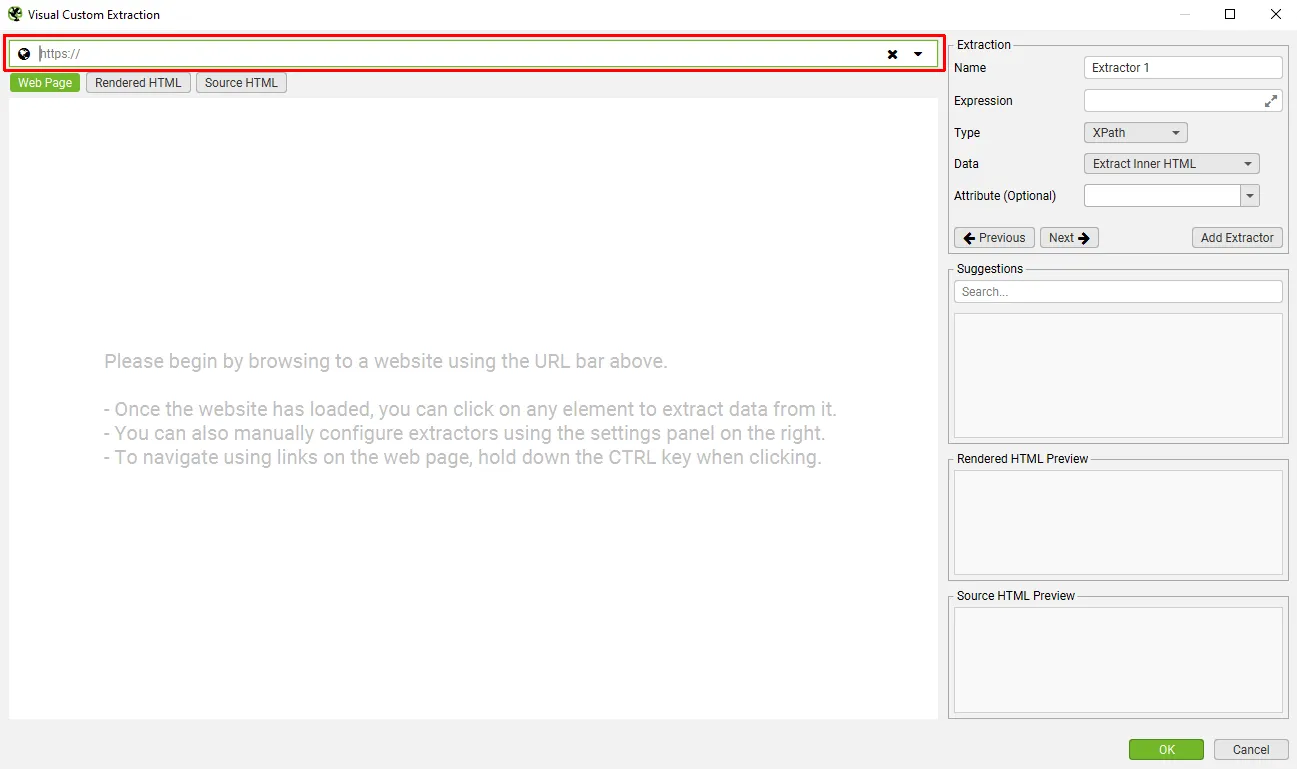

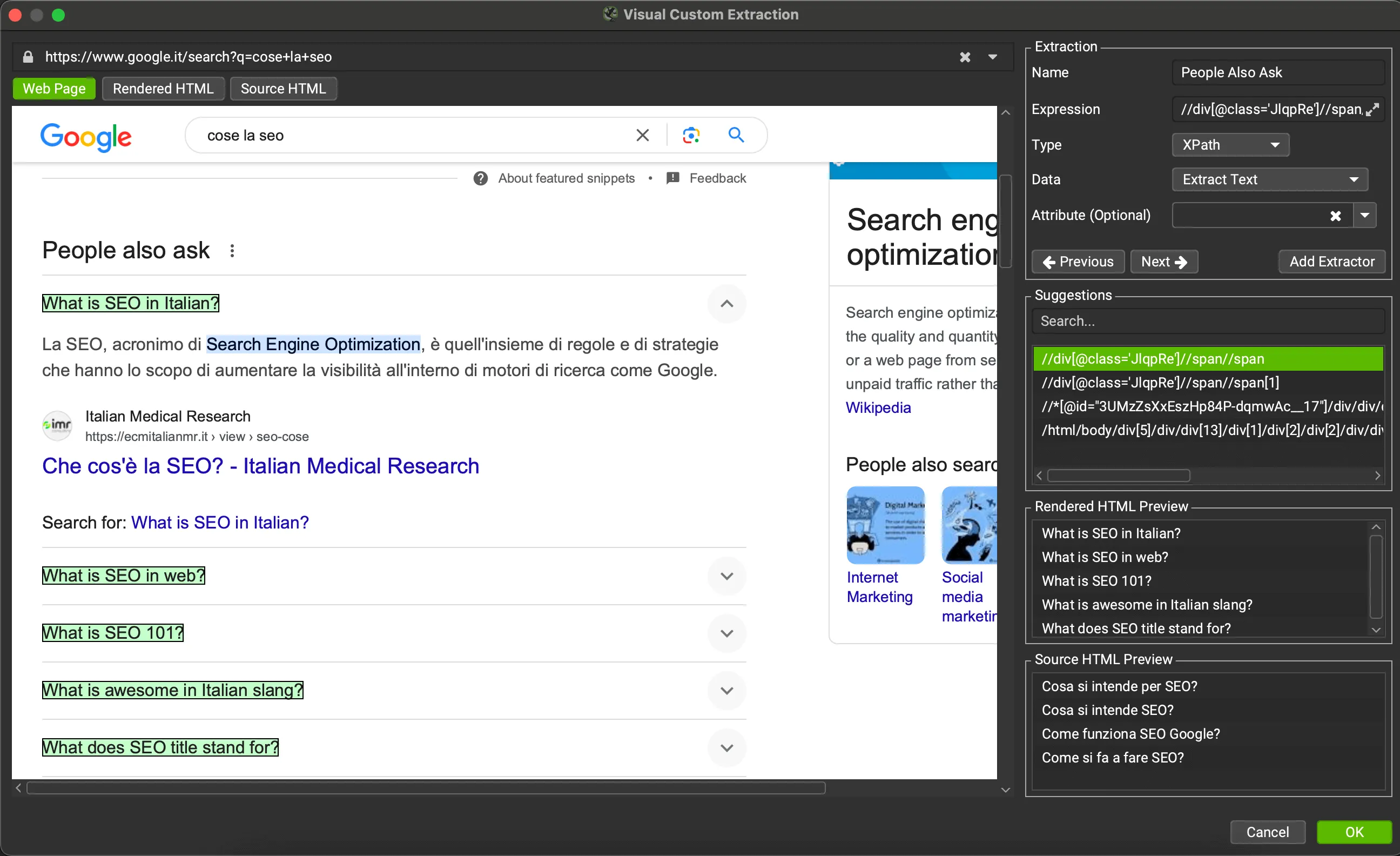

Se hai già dimestichezza con le espressioni Xpath puoi inserirle direttamente nella cella “Enter Xpath” oppure puoi optare per la versione “Visual” del Seo Spider che ti permette in pochi click, di comprendere in modo visivo le informazioni da estrapolare utilizzando il browser interno di Screaming Frog.

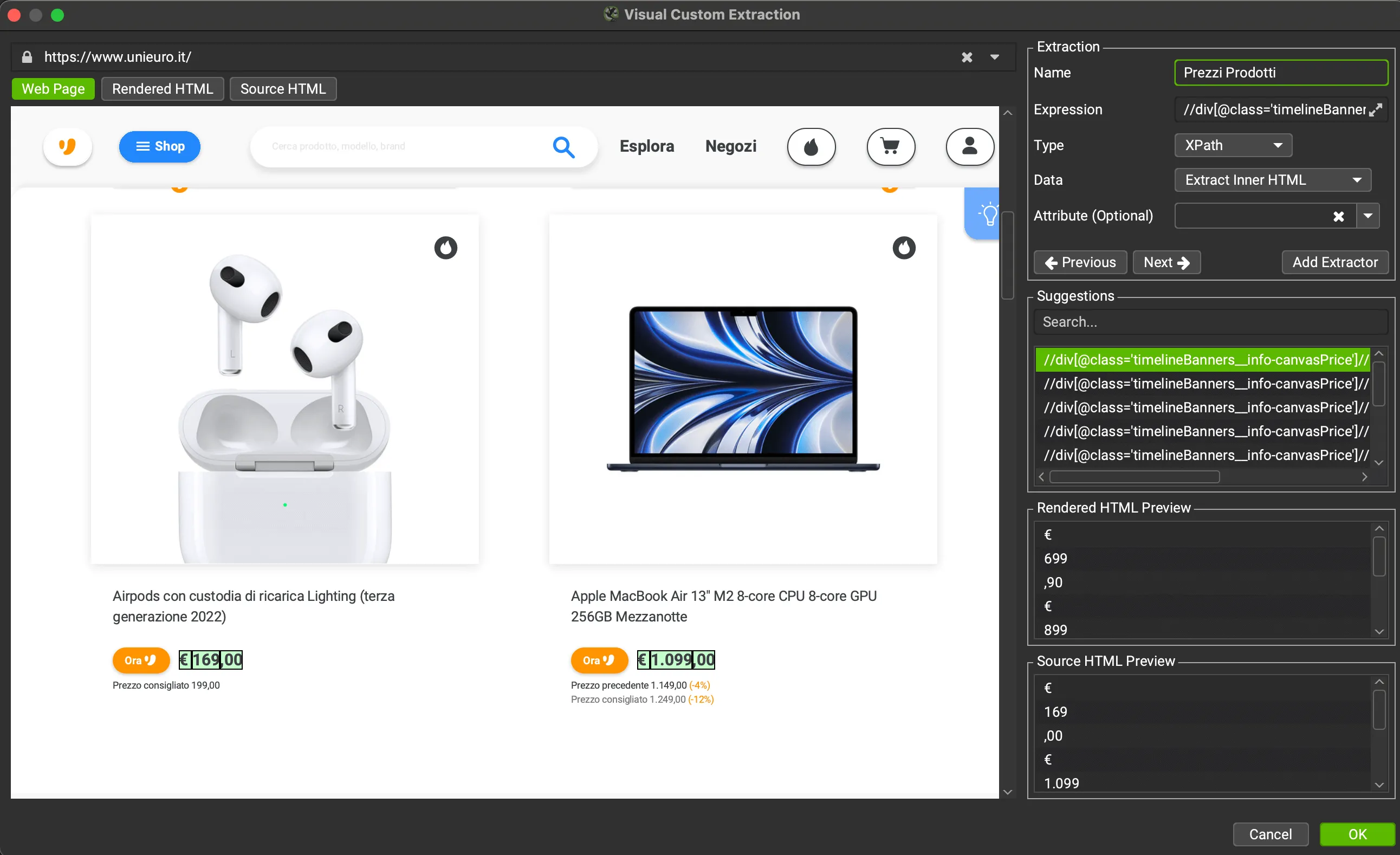

Successivamente, selezionando l’elemento sulla pagina che desideri estrarre il SEO Spider evidenzierà quindi l’area sulla pagina e creerà una varietà di espressioni suggerite (le troverai a destra) e un’anteprima di ciò che verrà estratto in base all’HTML Raw o renderizzato.

Nell’esempio sopra ho selezionato i prezzi dei prodotti (cliccato sui prezzi) e, come vedi a destra il SEO Spider ha inserito la corretta sintassi per l’estrazione.

Le estrazioni a disposizioni (“data”) sono essenzialmente 4:

- Estrai Elemento HTML: l’elemento selezionato e tutto il suo contenuto HTML interno.

- Estrai HTML Interno: il contenuto HTML interno dell’elemento selezionato. Se l’elemento selezionato contiene altri elementi HTML, saranno inclusi.

- Estrai Testo: il contenuto testuale dell’elemento selezionato e il contenuto testuale di eventuali elementi figlio.

- Valore della Funzione: il risultato della funzione fornita, ad esempio count(//h1) per trovare il numero di tag h1 in una pagina.

Una volta elaborato il crawl i dettagli della Custom Extraction la potrai trovare nella tab dedicata; nel caso ci fossero più di una estrazione potrai utilizzare i filtri per switchare tra le diverse estrazioni.

Web Scraping della SERP

Oltre al web scraping interno o verso siti specifici dei competitors è possibile fare estrazioni anche su directory e sullo stesso Motore di Ricerca. Questa attività, comunque da fare con una certa attenzione per non essere bannati l’IP, risulta molto utile ad esempio nella raccolta dati del posizionamento rispetto a certe parole chiavi strategiche.

Screaming Frog non sostituisce servizi come Semrush o Seozoom ma per parole chiavi da rankare può essere un buon strumento per verificare posizionamento dei competitors, caratteristiche dei siti più vincenti etc.

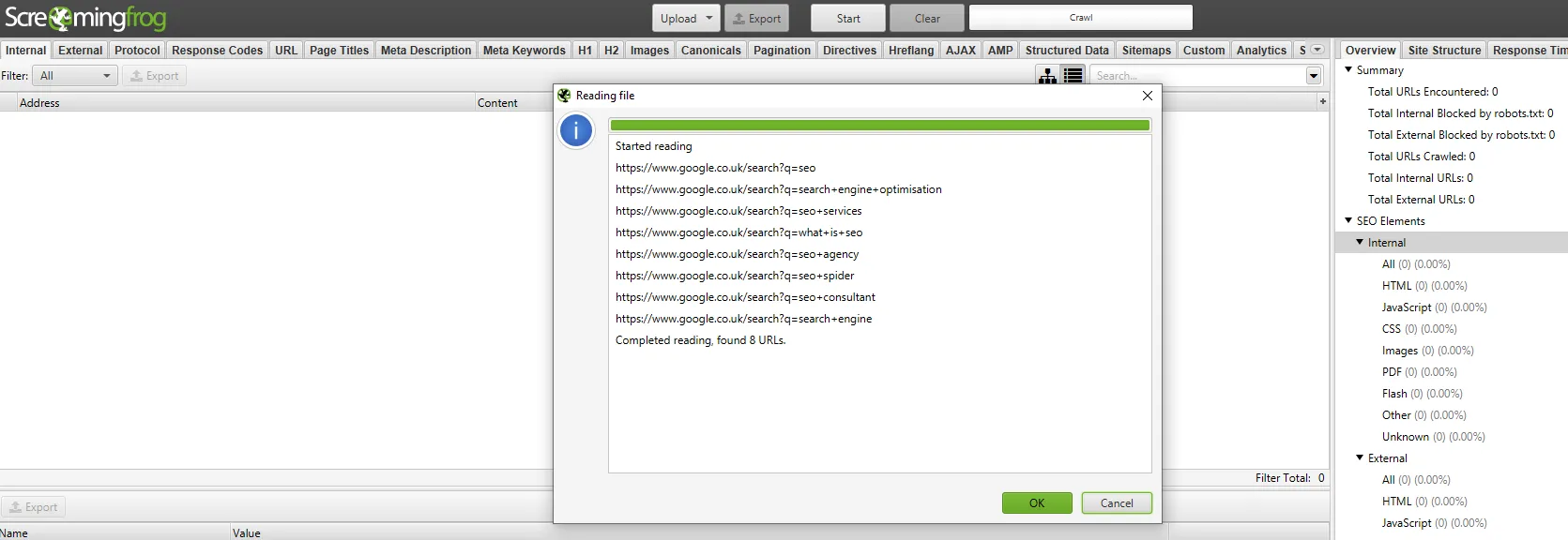

- Il primo passo sarà quello di creare un “Google Search query” Url che dovrà essere scansionato dal Seo Spider. Questo passaggio può essere elaborato semplicemente utilizzando il seguente modulo di Google Spreadsheet.

- Il secondo passaggio sarà quello di configurare il SEO Spider in modo opportuno:

- Utilizzare il rendering JS.

- Impostare “Ignore Robots.txt”.

- Utilizzare lo user agent “Chrome”.

- Diminuire la velocità di scansione (Max Threads = 1 | Max URI/s = 0,5)

Il consiglio è quello di salvare questa configurazione come nuovo “profilo” per utilizzarlo ogni volta necessario.

Come creare un profilo personalizzato con Screaming Frog.

Screaming Frog SetUP

Conclusa la fase di configurazione tecnica di Screaming Frog è tempo di definire la sintassi per l’estrazione dei dati personalizzati dalla serp attraverso una scansione in modalità “List”.

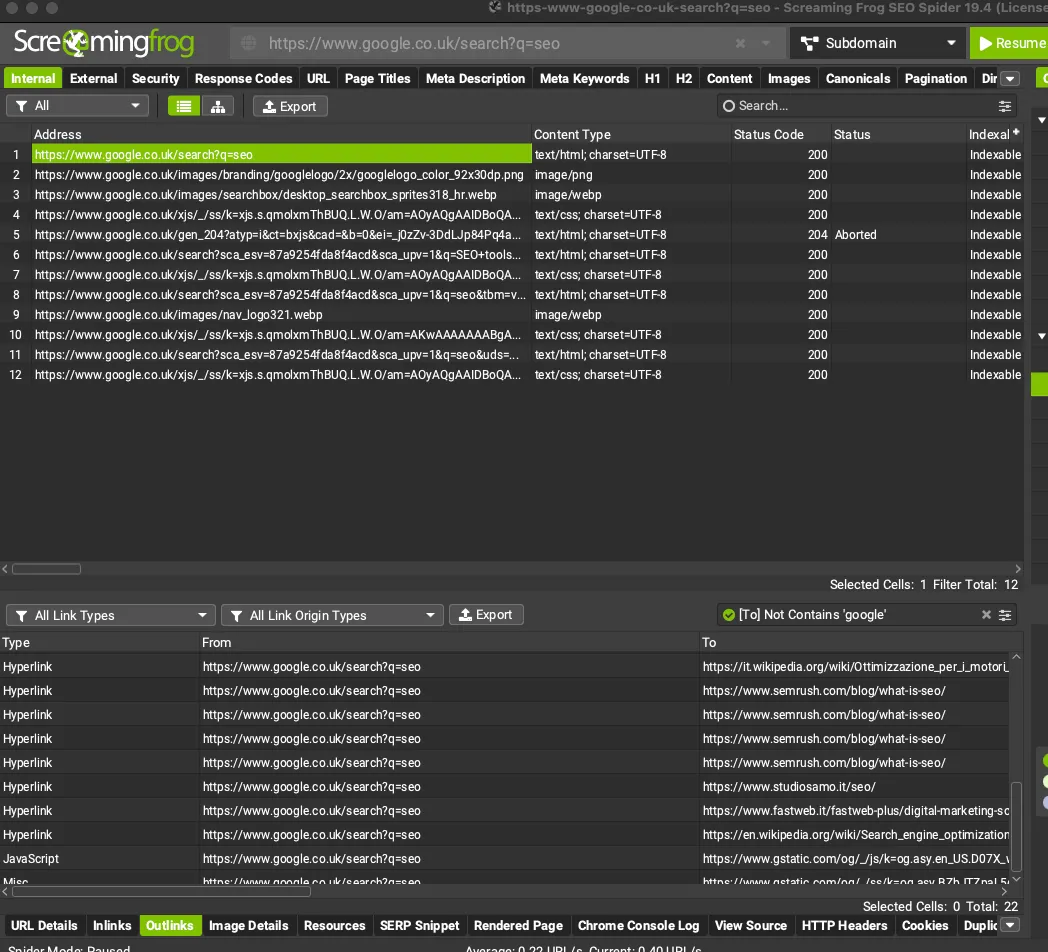

Di default, elaborando un crawler con le Url generate con la modalità List, otterrai dei risultati già interessanti guardando la tab inferiore “Outlinks” nella quale troverai gli URL posizionati per quella specifica query.

Come potrai constatare ci saranno notevoli riferimenti a collegamenti Google, quindi il consiglio è utilizzare il filtro nella tab inferiore e inserire la sintassi “TO” non contiene Google ([To] Not Contains ‘Google”).

Oltre a questa funzione base possiamo elaborare dei seo audit delle serp maggiormente avanzati utilizzando la Custom Extraction ad esempio delle “Also people Ask”, le featured snippet, presenza di video o altro che definisce la tipologia di Serp. Le sintassi XPath le potrai trovare utilizzando il Browser interno del Seo Spider.

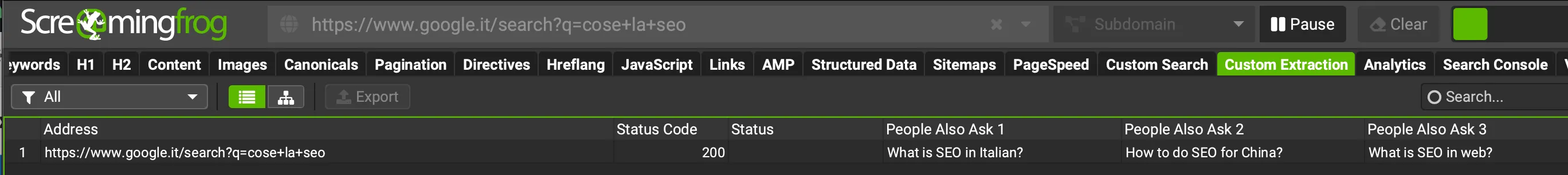

Web Scraping On Field

L’obiettivo di questo test sarà quello di estrarre i dati relativi a “People also Ask” dalla serp. La nostra query di riferimento sarà: “Cos’è la Seo“.

- Inseriamo questa Url generata con il nostro “Url generator: https://www.google.it/search?q=cose+la+seo.

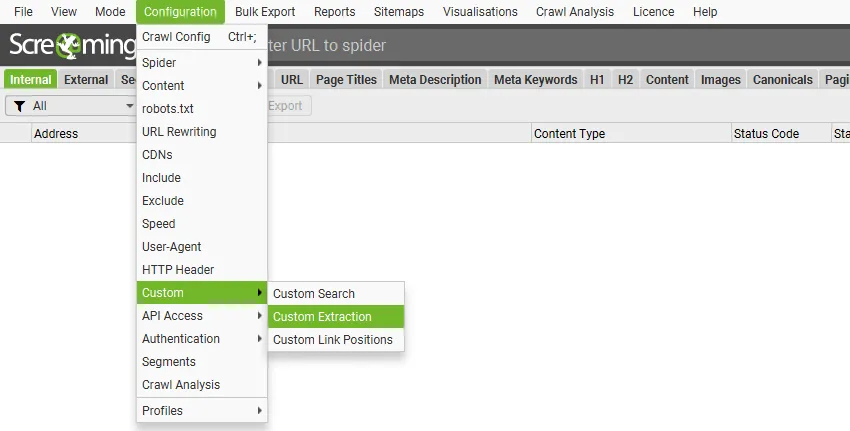

- Apriamo Config > Custom > Custom Extraction e utilizziamo il browser interno.

- Avviamo la scansione (modalità list) e consultiamo i dati nella tab Custom Extraction.

Nello stesso modo sarà possibile in modo molto semplificato estrarre tutte le altre features di Google ed ottenere una visione d’insieme e granulare avanzata per i nostri Seo Audit!

RICORDA: Il modulo che hai utilizzato precedentemente prevede alcune sintassi XPath già configurate ma essendo il Motore di Ricerca in continuo aggiornamento potrebbero non restituire risultati attendibili, il mio consiglio è utilizzare sempre il Browser interno per queste analisi!

RAFFAELE VISINTIN

Consulente Seo e autore delle guide di Screaming Frog Club.