Embeddings SEO con Screaming Frog

Guida pratica all'Analisi Semantica

Dimentica le keyword esatte. Nel 2025, Google ragiona per Vettori Semantici. In questa guida operativa impariamo a usare Screaming Frog + OpenAI per:

Cosa sono gli Embeddings?

Gli Embeddings sono la traduzione delle parole in numeri (vettori). Immagina di trasformare ogni pagina del tuo sito in una coordinata GPS multidimensionale:

- Vettorializzazione: l’AI trasforma il testo in una lista di numeri (es. [0.1, -0.5, 0.8]).

- Prossimità: Due pagine che parlano dello stesso argomento avranno vettori vicini nello spazio matematico, anche se usano parole diverse (es. “Auto” e “Vettura”).

- Applicazione SEO: Questo ci permette di capire come Google raggruppa i nostri contenuti e di scoprire “buchi” semantici nella nostra struttura.

Gli embeddings stanno rapidamente diventando un elemento fondamentale nel campo dell’intelligenza artificiale (IA) e del machine learning (ML). Questi strumenti potenti consentono di rappresentare dati complessi in formati più gestibili, migliorando significativamente l’efficacia degli algoritmi di apprendimento automatico.

Gli embeddings sono rappresentazioni vettoriali di oggetti complessi come parole, immagini o utenti. Essi trasformano dati non numerici in una forma numerica che può essere facilmente elaborata dagli algoritmi di ML (Machine Learning).

Trasformare questi dati in rappresentazioni vettoriali ti consentirà, in modo efficace, di scoprire relazioni e pattern utilissime per la gestione strategica di analisi complesse.

Le dimensioni di un vettore sarà determinata dal modello utilizzato di embedding e determinerà la sua capacità di rappresentare i significati di una parola o di un documento con una serie di numeri maggiormente esemplificativi per i Bot.

La dimensione del vettore rappresenta la profondità di analisi codificate all’interno dello spazio di embedding.

Ma quali dati si possono ricavare da questi vettori? Ad esempio nell’emdedding delle parole si potrà ricavare aspetti semantici, sintattici e contestuali; maggiore sarà la dimensione del vettore e maggiori saranno i dettagli delle informazioni. Attraverso questi concetti si può comprendere come l’analisi passi in ambito Seo dallo studio asettico delle “parole chiave” alla scoperta del “Search intent” non secondo una nostra personale valutazione ma basato su analisi approfondite e sempre più simili a quelle messe in campo dagli Spider dei Motori di Ricerca.

Vantaggi degli Embeddings

- Riduzione della Dimensionalità: gli embeddings riducono la complessità dei dati originali mantenendo le informazioni rilevanti. Ciò permette una manipolazione e analisi più efficiente dei dati e nella Seo rappresentano delle vere miniere d’oro per analisi sempre più affine al comportamento dello spider del Motore di Ricerca.

- Miglioramento delle Prestazioni degli Algoritmi: grazie alla loro capacità di catturare relazioni semantiche, gli embeddings migliorano l’accuratezza e la precisione degli algoritmi di ML. Questo scenario è particolarmente evidente nelle applicazioni di elaborazione del linguaggio naturale (NLP) e nel riconoscimento delle immagini.

- Flessibilità e Applicabilità: gli embeddings possono essere applicati a diversi tipi di dati e in vari settori, dalle raccomandazioni di prodotto all’analisi del sentiment, rendendoli strumenti versatili per molteplici applicazioni. Ad esempio assegnando serie numeriche alle parole in termini di similarità semantica, il “Word embedding” permette ai modelli delle reti neurali di comprendere in modo assolutamente più significativo il contesto e quindi elaborarlo.

Applicazioni Embeddings nella Seo

- Elaborazione del Linguaggio Naturale (NLP): nel NLP, gli embeddings di parole come Word2Vec e GloVe permettono ai modelli di comprendere meglio il contesto e il significato delle parole nei testi. Questo ha rivoluzionato applicazioni come la traduzione automatica, l’analisi del sentiment e i chatbot intelligenti. I word embeddings possono essere utili per l’analisi e il targeting delle parole chiave, perché ci permettono di comprendere i significati e le relazioni tra le parole, oltre a identificare modelli e tendenze nei dati di testo aiutandoci ad identificare le query più importanti o rilevanti in un determinato testo. Ciò è utile ai fini della SEO, in quanto consente alle aziende di identificare le parole chiave più utilizzate dagli utenti quando cercano un particolare prodotto o servizio. Comprendendo le relazioni tra le parole, i word embeddings possono anche aiutare a identificare sinonimi e termini correlati che possono essere utili per il targeting delle parole chiave e per identificare i potenziali termini di ricerca che gli utenti potrebbero utilizzare quando cercano i prodotti dell’azienda.

- Raccomandazioni di Prodotti: un applicazione molto utile è legata agli e-commerce che analizzando gli embeddings possono presentare in modo puntuale e strategico i prodotti correlati in base alle similitudini tra prodotti e alle preferenze degli utenti. Questo approccio migliora l’esperienza del cliente e aumenta le vendite e non si limita alla proposta di prodotti “complementari” o della stessa categoria come comunemente avviene in automatico utilizzando i CMS più popolari. Attraverso gli embeddings sarà quindi possibile elaborare strategie sempre più accurate e performanti che vadano alla ricerca del punto di equilibrio tra domanda e offerta.

- Riconoscimento delle Immagini: gli embeddings sono utilizzati anche nel riconoscimento delle immagini, dove aiutano a identificare e classificare oggetti all’interno delle stesse. Tecniche come i convolutional neural networks (CNN) generano embeddings che rappresentano caratteristiche visive delle immagini, migliorando le performance di riconoscimento.

- SEO e Marketing Digitale: gli embeddings sono utilizzati anche per migliorare le strategie di SEO e marketing digitale, permettendo una migliore comprensione del comportamento degli utenti e una più efficace creazione di contenuti.

Analizziamo in modo maggiormente specifico le applicazioni Seo degli Embeddings:

- Clustering: nella SEO, i “cluster” si riferiscono a gruppi di contenuti correlati che ruotano attorno a un argomento principale. Ogni cluster include una “pillar page” centrale, che copre in modo ampio l’argomento, e pagine di supporto più specifiche che approfondiscono sotto-temi correlati. Questo approccio aiuta a organizzare meglio il contenuto del sito, migliorando la navigabilità e l’esperienza dell’utente, oltre a favorire una migliore indicizzazione da parte dei motori di ricerca. I cluster di contenuti permettono inoltre di aumentare l’autorità del sito su temi specifici, migliorando così il posizionamento nelle ricerche organiche.

- Classificazione: assegnazione di categorie a parole o documenti basata su modelli addestrati.

- Raccomandazioni: suggerimento di articoli rilevanti agli utenti.

- Misurazione di Somiglianza e Diversità: valutazione delle somiglianze e differenze tra parole e documenti. Questo scenario ti permetterà di evitare contenuti duplicati e di gestire potenziali situazioni di “cannibalizzazione” delle query proponendoti delle analisi molto specifiche che riescono ad intercettare anche i minimi dettagli e caratteristiche delle pagine scansionate.

- Rilevamento di Anomalie: identificazione di elementi che si discostano significativamente dai dati che permetteranno di ottimizzare l’architettura interna o per modificare i contenuti.

- Raccolta di Informazioni profilate: ottenimento di informazioni rilevanti da grandi dataset.

- Traduzione Linguistica, analisi del Sentimenti: un modo in cui le incorporazioni di parole aiutano la traduzione linguistica è fornire una rappresentazione comune delle parole in lingue diverse. Per tradurre una parola da una lingua all’altra, un modello di apprendimento automatico deve comprendere il significato della parola in entrambe le lingue. I word embedding possono fornire questa comprensione rappresentando le parole in modo indipendente dalla lingua. Ciò significa che un word embedding per una parola in una lingua può essere confrontato con un word embedding per la stessa parola in un’altra lingua, consentendo al modello di apprendimento automatico di comprendere il significato della parola in entrambe le lingue. Quindi questo approccio non si limiterà alla classica traduzione lessicale e sintattica ma proporrà dei contenuti contestualizzati nelle diverse versioni linguistiche che ci permetteranno di migliorare il ranking sulle Serp estere.

- Analisi del Sentiment: per creare un lessico dei sentimenti o delle emozioni utilizzando i word embeddings, si potrebbe iniziare selezionando un insieme di parole o frasi che sono note per essere associate a particolari sentimenti o emozioni. Potrebbe trattarsi di parole o frasi che sono state annotate dagli esseri umani per il sentimento o l’emozione, oppure di parole o frasi comunemente usate nei social media o in altre piattaforme online per esprimere particolari sentimenti o emozioni.Una volta selezionata una serie di parole o frasi, il passo successivo sarà quello di utilizzare le incorporazioni di parole per creare vettori per ciascuna di queste parole o frasi. Questi vettori possono essere creati utilizzando un modello di word embedding pre-addestrato, oppure possono essere creati da zero utilizzando algoritmi di apprendimento automatico e un ampio set di dati testuali. Una volta creati i vettori per le parole o le frasi del lessico, questi possono essere utilizzati per identificare il sentimento o l’emozione associati ad altre parole o frasi. Ad esempio, se una parola o una frase risulta simile a un vettore del lessico associato a un particolare sentimento o emozione, si può dedurre che la parola o la frase è anche associata a quel sentimento o emozione (fonte: https://marketbrew.ai/word-embeddings-a-comprehensive-guide).

- Generazione dei Contenuti: le informazioni degli embeddings possono essere utilizzate per generare nuove frasi correlate al testo originale. Ad esempio, supponendo di avere un testo sull’Outdoor con il Word Embedding potremo identificare parole e frasi rilevanti sull’argomento come “campeggio”, “vita all’aperto” che ci permetteranno di migliorare il contenuto della pagina in ottica di renderlo maggiormente pertinente al “Search Intent” dell’Outdoor. Oltre alla generazione di contenuti completi, attraverso il word embeddings potremo calcolare la similarità semantica di una “query” rispetto alle altre di un vocabolario (cosine similarity) per rendere più fruibile il nostro contenuto senza gli ostacoli di un copy legato alla sua mera funzione Seo. Un’elevata somiglianza del “cosine similarity” indicherà che i vettori sono simili, mentre una bassa somiglianza del coseno indicherà che sono diversi e non potranno essere considerati sinonimi a livello semantico per lo Spider .

- Contextual Word Prediction: attraverso gli embeddings potremo migliorare l’accuratezza del completamento automatico o della funzione del testo predittivo. Gli embeddings catturano il contesto in cui le parole appaiono e quindi saranno in grado di utilizzarli per prevedere la parola successiva in base alle parole che la precedono permettendo un completamento automatico della ricerca interna. Questa attività, assieme alla sempre valida analisi tramite Google Analytics 4 delle query utilizzate nel proprio sito web ci permetterà di migliorare la UX ad esempio del nostro e-commerce e servire la migliore proposta possibile al potenziale buyer.

Nelle guide precedenti abbiamo posto l’attenzione sull’importanza delle analisi N-Gram ma con gli embeddings potrai fare un notevole update delle informazioni.

In termini di efficacia SEO, i word embeddings presentano diversi vantaggi; in prima istanza consentono una comprensione meno approssimativa del significato e del contesto delle parole all’interno di un documento, che può essere utile per determinare la rilevanza e la qualità di una pagina web, rispetto a trattare l’analisi come frequenza delle singole entità che rimangono valide per l’architettura interna ma non specifiche come questo scenario che stiamo descrivendo. Altresì attraverso gli N-Gram non è possibile individuare termini correlati e quindi la potenza di analisi si riduce in modo inequivocabile.

Screaming Frog, embedding e API ChatGpt

Brief:

Per attivare l’analisi semantica nel crawler, segui questi passaggi esatti:

- Prepara l’API Key: vai su OpenAI Platform, genera una nuova Secret Key e copiala.

- Configura il Custom JavaScript:

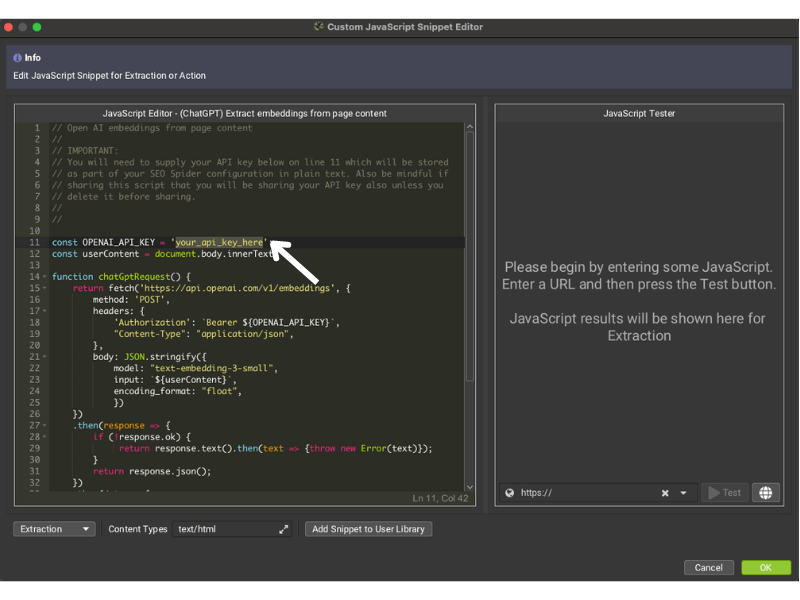

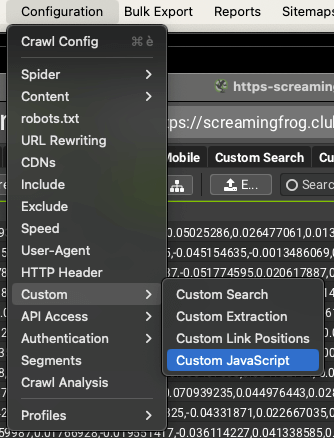

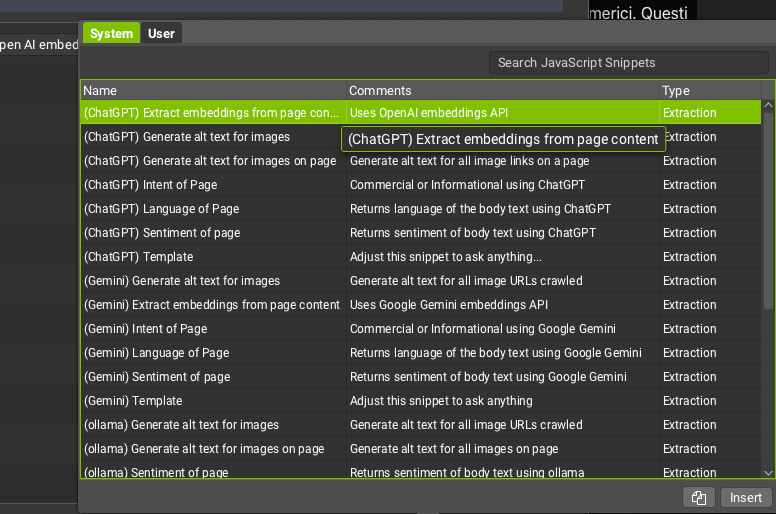

- Apri Screaming Frog e vai su Configuration > Custom > Custom JavaScript.

- Clicca su “Add from Library” (in basso a destra).

- Seleziona lo snippet ufficiale: (ChatGPT) Extract embeddings from page.

- Inserisci la Chiave:

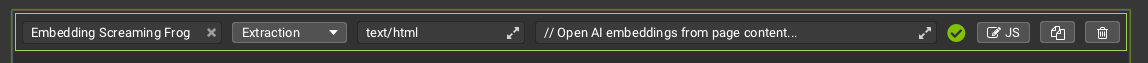

- Clicca sull’icona “JS” dello snippet appena aggiunto.

- Incolla la tua API Key nella riga di codice indicata (solitamente const apiKey = ‘TUA_CHIAVE’;).

- Avvia la Scansione: Lancia il crawl. Il software interrogherà OpenAI per ogni URL, salvando il vettore nella tab Custom JavaScript.

Con la versione 20 di Screaming Frog SEO Spider, sono stati introdotti gli “embedding” nel Seo Spider generati utilizzando un modello di OpenAI e attraverso le API direttamente con una funzione interna del tool.

Per implementare questa funzione, Screaming Frog ha integrato la possibilità di eseguire funzioni JavaScript personalizzate che sarà a disposizione tramite la sezione Custom > Custom JavaScript, dove è possibile scegliere lo script dedicato e inserire la chiave API di OpenAI per iniziare a generare embeddings durante la scansione.

Una volta scelto Custom Javascript sarà sufficiente cliccare su “+Add from Library” e scegliere la prima proposta di Screaming Frog “(ChatGPT) Extract embeddings from page..”

Cliccando sull’icona “JS” potrai modificare lo script ed inserire l’API generata con OpenAI.

Di seguito la schermata dove inserire la propria API Key. Una volta “copiata e incollata” nello spazio riservato sarà sufficiente elaborare la scansione con Screaming Frog per ottenere gli embeddings. Visto che l’utilizzo delle API ha un costo il consiglio è quello di utilizzare il “Javascript Tester” inserendo un URL da analizzare per visualizzare in anteprima il possibile risultato che si otterrà con una scansione completa.

I risultati del “Custom Javascript” potranno essere letti nella tab dedicata scegliendo tra i filtri nel caso fossero attive diverse estrazioni o azioni richieste attraverso la “Custom JS”.

Nel caso ci sia la necessità di condividere la scansione o la configurazione di Screaming Frog è necessario cancellare le API per non fornire questo dato. Dai rumors della community è stato già chiesto agli sviluppatori di Screaming Frog di oscurare le API una volta inserite per proteggere questo prezioso e costoso dato.

Ma ora che abbiamo ottenuto gli embedding da Screaming Frog cosa possiamo elaborare i nostri nuovi dati? Come abbiamo visto ci sono numerosi utilizzi degli embeddings, vediamo assieme il procedimento per scoprire in base ai vettori ottenuti un’analisi molto accurate delle pagine correlate.

Visualizza i tuoi Cluster con Python

Brief:

Hai estratto i dati. E adesso? Usa questo script Python (compatibile con Google Colab) per trasformare i numeri grezzi in una Mappa Visiva 2D.

- Input: Il file CSV esportato da Screaming Frog (colonne: Address, Embeddings).

- Output: Un grafico a dispersione che mostra visivamente come i tuoi articoli si raggruppano per argomento.

- A cosa serve: Identifica a colpo d’occhio le pagine “orfane semanticamente” (punti isolati) che necessitano di link interni.

Step by Step:

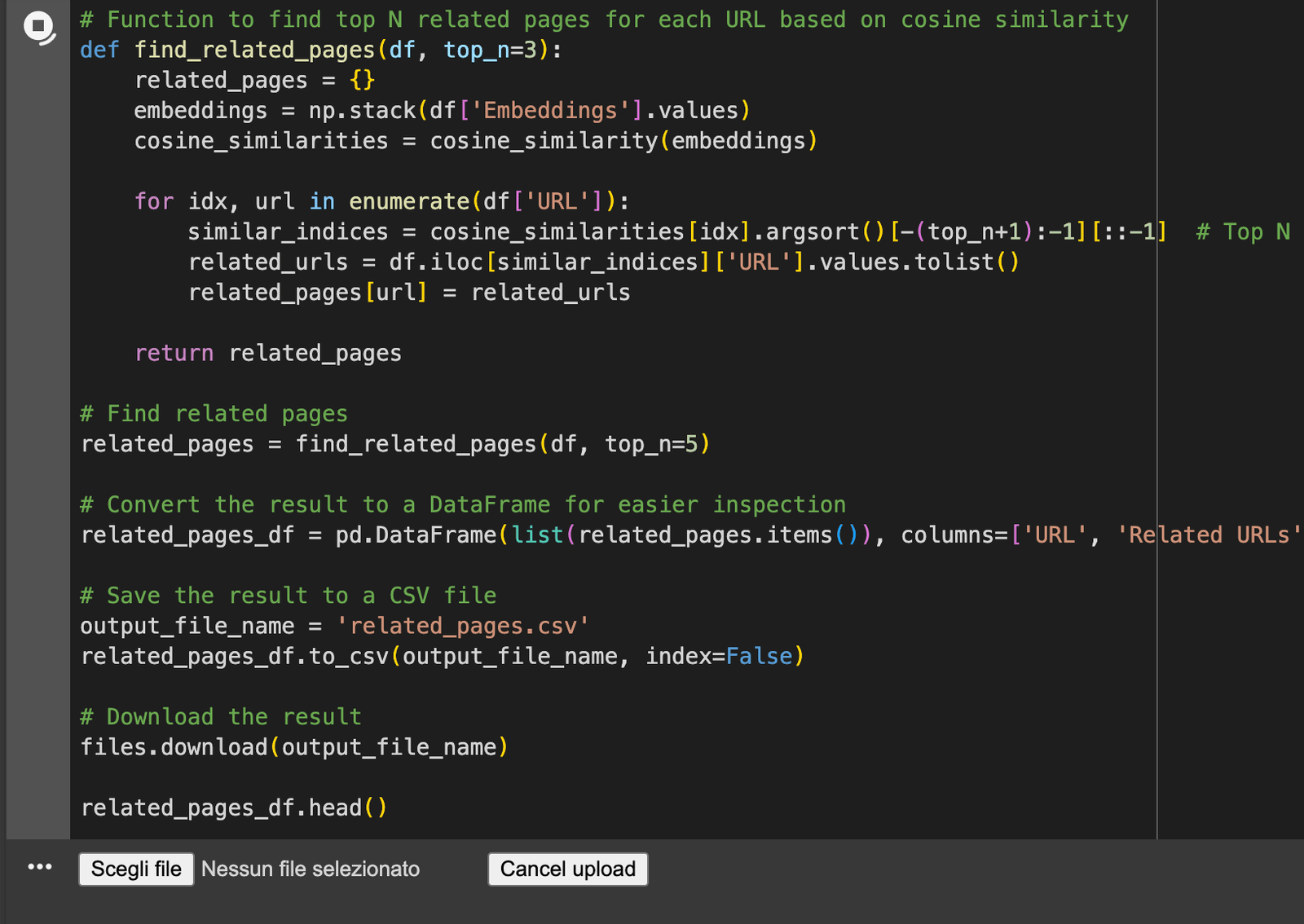

Un primo esempio di applicazione potrebbe essere quello di comprendere le interconnessioni tra le pagine di un sito web o tra le pagine dettaglio di un e-commerce per fornire al meglio un’esperienza ottimale al visitatore o potenziale “buyer”.

Vediamo come fare:

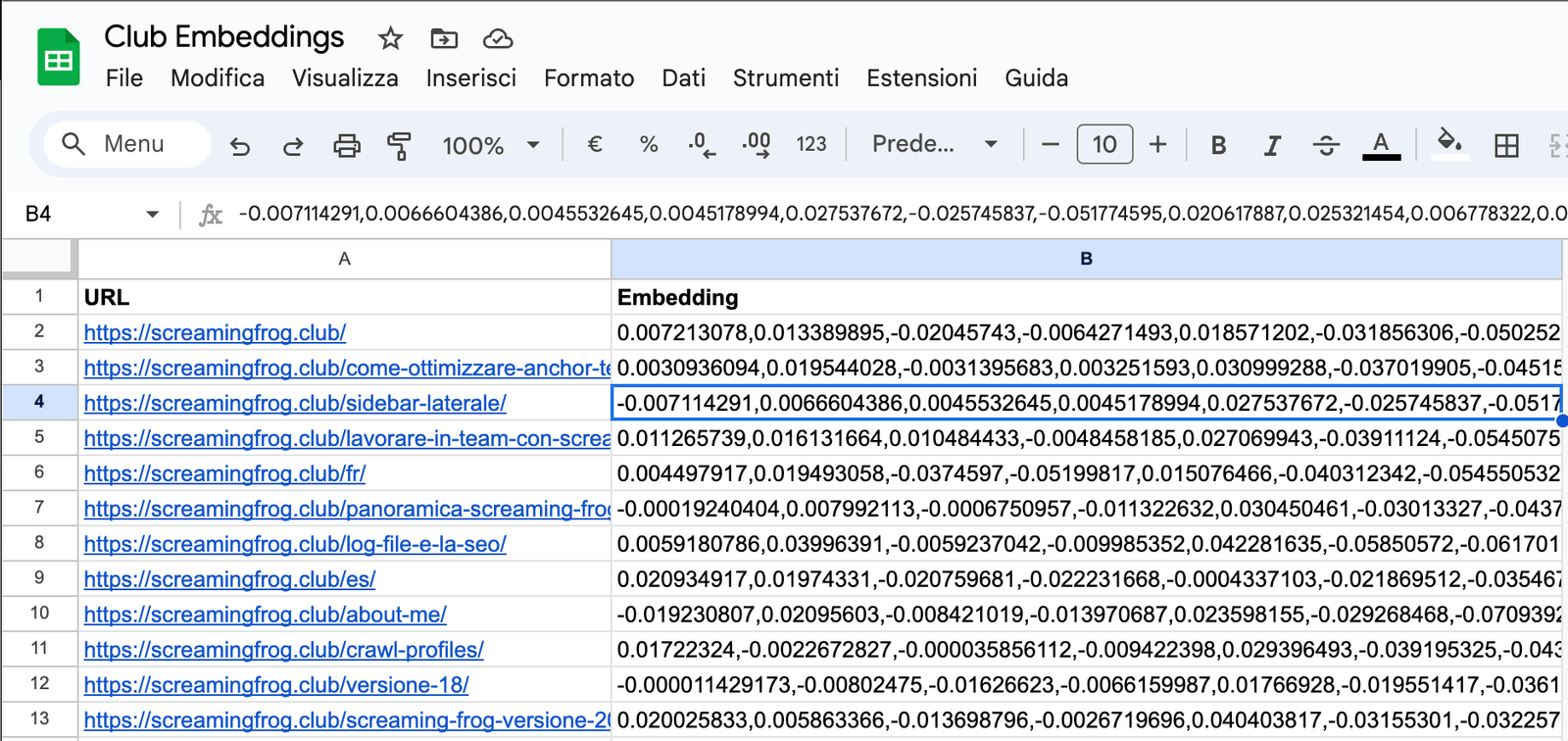

- Ottengo gli embeddings con Screaming Frog.

- Esporto i dati del Seo Spider e formatto il file ottenuto sostituendo “Address” con “URL”.

- Elimino le colonne “Status Code” e “Status”. In questo caso avrai solamente 2 headers:

- URL.

- Embeddings.

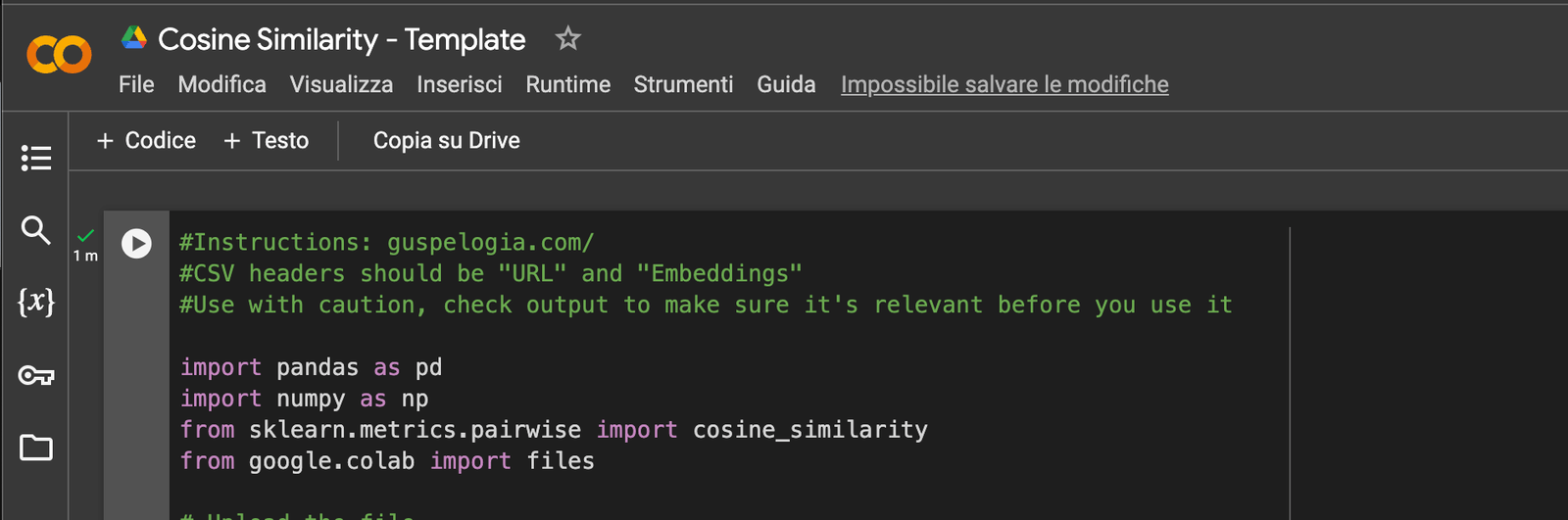

A questo punto potrai utilizzare uno script Python su Coleb per elaborare i tuoi dati. Di seguito uno “script di Gus Pelogia” per l’elaborazione.

Lo strumento ti chiederà di caricare il tuo file CSV (quello proveniente da Screaming Frog).

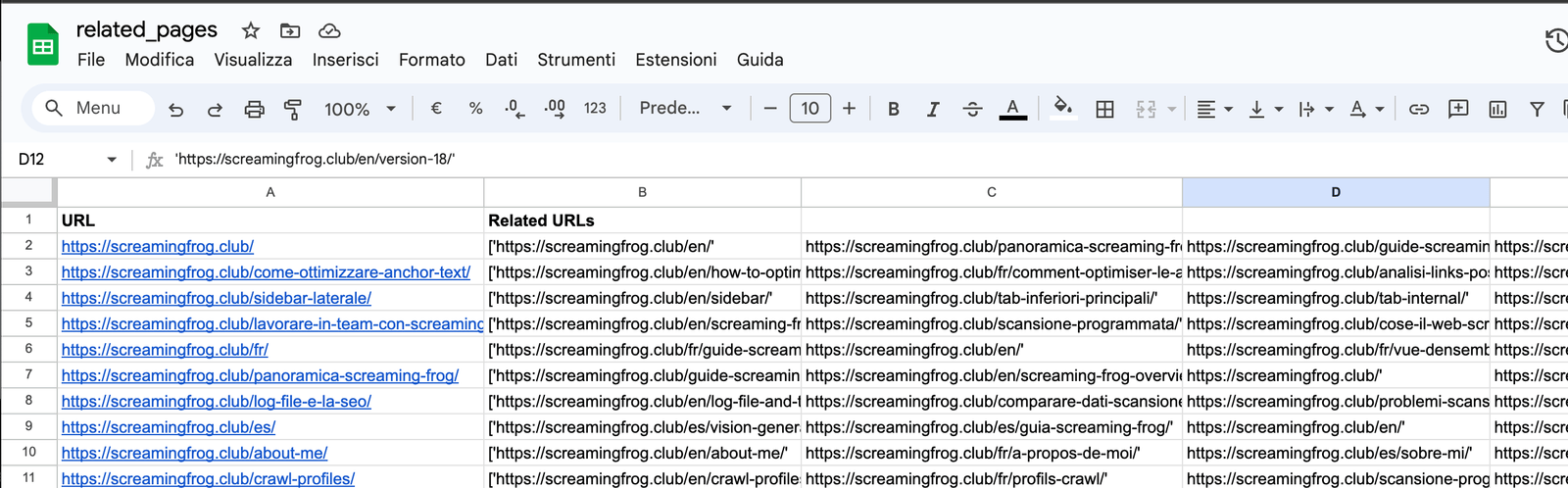

Una volta elaborati i dati, scaricherà automaticamente un altro CSV con i risultati categorizzati in due colonne (se utilizzate Google Spreadsheet dovrete tabulare i dati in colonne):

- Fonte della pagina.

- Pagine correlate.

Basterà cliccare sull’icona “Play” e Colab ti permetterà di fare l’upload del file ottenuto da Screaming Frog.

Alla fine dell’elaborazione sarà scaricato automaticamente in locale un nuovo file denominato “related_pages.csv“.

Ora non ti resta che verificare i risultati e applicare le corrette modifiche al sito per una “correlazione” ottimale dei contenuti a livello semantico. Se applicato ai prodotti di un e-commerce potrebbe rappresentare un ottima strategia per migliorare ROI e carrello medio.

Clustering

Per il clustering attraverso gli embeddings potresti utilizzare diversi algoritmi di clustering come K-means o DBScan che utilizzano diverse metriche di similarità per creare dei gruppi omogenei. Per creare uno script ho utilizzato le librerie “pandas” per la manipolazione dei dati, “sklearn” per il clustering e “matplotlib + seaborn” per la visualizzazione di un immagine e di un documento in output in csv. Il file che ho utilizzato come dataset è stato formattato come il precedente con due colonne “URL” e “Embeddings”.

RAFFAELE VISINTIN

Consulente Seo e autore delle guide di Screaming Frog Club.