Qu’est-ce qu’un emboîtement ?

Les emboîtements deviennent rapidement un élément clé dans le domaine de l’intelligence artificielle (IA) et de l’apprentissage machine (ML). Ces outils puissants permettent de représenter des données complexes dans des formats plus faciles à gérer, ce qui améliore considérablement l’efficacité des algorithmes d’apprentissage automatique.

Les encastrements sont des représentations vectorielles d’objets complexes tels que des mots, des images ou des utilisateurs. Ils transforment les données non numériques en une forme numérique qui peut être facilement traitée par les algorithmes de ML (Machine Learning).

La transformation de ces données en représentations vectorielles vous permettra effectivement de découvrir des relations et des modèles utiles à la gestion stratégique d’analyses complexes.

La taille d’un vecteur sera déterminée par le modèle d’intégration utilisé et déterminera sa capacité à représenter la signification d’un mot ou d’un document à l’aide d’un ensemble de nombres plus illustratifs pour les robots.

La taille du vecteur représente la profondeur de l’analyse encodée dans l’espace d’intégration.

Mais quelles données peut-on tirer de ces vecteurs ? Par exemple, les aspects sémantiques, syntaxiques et contextuels peuvent être déduits de l’encodage des mots ; plus la taille du vecteur est grande, plus les informations sont détaillées. A travers ces concepts, on peut comprendre comment l’analyse passe, dans le domaine du Seo, de l’étude aseptisée des « mots-clés » à la découverte de« l’intention de recherche« , non pas en fonction de notre évaluation personnelle, mais sur la base d’analyses approfondies, de plus en plus semblables à celles effectuées par les Search Engine Spiders.

Avantages de l’intégration

- Réduction de la dimensionnalité: les encastrements réduisent la complexité des données d’origine tout en conservant les informations pertinentes. Ils permettent une manipulation et une analyse plus efficaces des données et, dans le domaine du référencement, ils représentent de véritables mines d’or pour une analyse de plus en plus proche du comportement de l’araignée du moteur de recherche.

- Amélioration des performances des algorithmes: grâce à leur capacité à capturer les relations sémantiques, les embeddings améliorent l’exactitude et la précision des algorithmes de ML. Ce scénario est particulièrement évident dans les applications de traitement du langage naturel (NLP) et de reconnaissance d’images.

- Flexibilité et applicabilité: les embeddings peuvent être appliqués à différents types de données et dans différents domaines, des recommandations de produits à l’analyse des sentiments, ce qui en fait des outils polyvalents pour de multiples applications. Par exemple, en attribuant des séries numériques aux mots en termes de similarité sémantique, le « word embedding » permet aux modèles de réseaux neuronaux de comprendre le contexte d’une manière absolument plus significative et donc de le traiter.

Applications de l’intégration dans le domaine du référencement

- Traitement du langage naturel (NLP): dans le NLP, les enchâssements de mots tels que Word2Vec et GloVe permettent aux modèles de mieux comprendre le contexte et la signification des mots dans les textes. Cela a révolutionné des applications telles que la traduction automatique, l’analyse des sentiments et les chatbots intelligents. L’intégration de mots peut être utile pour l’analyse et le ciblage des mots clés, car elle nous permet de comprendre le sens des mots et les relations entre eux, ainsi que d’identifier des modèles et des tendances dans les données textuelles, ce qui nous aide à identifier les requêtes les plus importantes ou les plus pertinentes dans un texte donné. Cela est utile pour le référencement, car cela permet aux entreprises d’identifier les mots-clés les plus utilisés par les utilisateurs lorsqu’ils recherchent un produit ou un service particulier. En comprenant les relations entre les mots, l’intégration de mots peut également aider à identifier les synonymes et les termes apparentés qui peuvent être utiles pour le ciblage des mots clés et pour identifier les termes de recherche potentiels que les utilisateurs pourraient utiliser lorsqu’ils recherchent les produits de l’entreprise.

- Recommandations de produits: une application très utile est liée au commerce électronique qui, en analysant les encastrements, peut présenter des produits apparentés de manière opportune et stratégique sur la base des similitudes entre les produits et les préférences de l’utilisateur. Cette approche améliore l’expérience du client et augmente les ventes. Elle ne se limite pas à proposer des produits « complémentaires » ou des produits de la même catégorie, comme cela se fait généralement de manière automatique à l’aide des systèmes de gestion de contenu les plus populaires. Grâce aux embeddings, il sera donc possible de développer des stratégies de plus en plus précises et performantes qui recherchent l’équilibre entre l’offre et la demande.

- Reconnaissance d’images: les encastrements sont également utilisés dans la reconnaissance d’images, où ils permettent d’identifier et de classer des objets dans des images. Des techniques telles que les réseaux neuronaux convolutifs (CNN) génèrent des encastrements qui représentent les caractéristiques visuelles des images, améliorant ainsi les performances de reconnaissance.

- Référencement et marketing numérique: les embeddings sont également utilisés pour améliorer les stratégies de référencement et de marketing numérique, ce qui permet de mieux comprendre le comportement des utilisateurs et de créer un contenu plus efficace.

Examinons plus précisément les applications des Embeddings dans le domaine du référencement :

- Regroupement : dans le domaine du référencement, les « regroupements » font référence à des groupes de contenu apparenté tournant autour d’un sujet principal. Chaque groupe comprend une « page pilier » centrale, qui couvre largement le sujet, et des pages complémentaires plus spécifiques qui approfondissent les sous-thèmes connexes. Cette approche permet de mieux organiser le contenu du site, d’améliorer la navigabilité et l’expérience de l’utilisateur, et de faciliter l’indexation par les moteurs de recherche. Les regroupements de contenu permettent également d’accroître l’autorité du site sur des sujets spécifiques, améliorant ainsi son classement dans les recherches organiques.

- Classification : attribution de catégories à des mots ou à des documents sur la base de modèles formés.

- Recommandations : suggestion d’articles pertinents aux utilisateurs.

- Mesurer la similitude et la diversité : évaluer les similitudes et les différences entre les mots et les documents. Ce scénario vous permettra d’éviter le contenu en double et de gérer la « cannibalisation » potentielle des requêtes en proposant des analyses très spécifiques qui parviennent à intercepter les moindres détails et caractéristiques des pages scannées.

- Détection des anomalies : identification des éléments qui s’écartent significativement des données, ce qui permettra d’optimiser l’architecture interne ou de modifier le contenu.

- Collecte d’informations profilées : obtention d’informations pertinentes à partir de vastes ensembles de données.

- Traduction linguistique, analyse des sentiments : L’une des façons dont les enchâssements de mots facilitent la traduction linguistique est de fournir une représentation commune des mots dans différentes langues. Pour traduire un mot d’une langue à une autre, un modèle d’apprentissage automatique doit comprendre le sens du mot dans les deux langues. L’intégration des mots peut permettre cette compréhension en représentant les mots de manière indépendante de la langue. Cela signifie que l’intégration d’un mot dans une langue peut être comparée à l’intégration du même mot dans une autre langue, ce qui permet au modèle d’apprentissage automatique de comprendre le sens du mot dans les deux langues. Cette approche ne se limitera donc pas à une traduction lexicale et syntaxique classique, mais proposera un contenu contextualisé dans les différentes versions linguistiques qui nous permettra d’améliorer notre classement sur les Serpos étrangers.

- Analyse des sentiments: pour créer un lexique de sentiments ou d’émotions à l’aide d’enchâssements de mots, on peut commencer par sélectionner un ensemble de mots ou de phrases que l’on sait associés à des sentiments ou à des émotions particuliers. Il peut s’agir de mots ou d’expressions qui ont été notés par des humains pour désigner des sentiments ou des émotions, ou de mots ou d’expressions couramment utilisés dans les médias sociaux ou sur d’autres plateformes en ligne pour exprimer des sentiments ou des émotions particuliers.Une fois qu’un ensemble de mots ou d’expressions a été sélectionné, l’étape suivante consiste à utiliser l’intégration de mots pour créer des vecteurs pour chacun de ces mots ou expressions. Ces vecteurs peuvent être créés à l’aide d’un modèle d’intégration de mots pré-entraîné, ou ils peuvent être créés à partir de zéro en utilisant des algorithmes d’apprentissage automatique et un grand ensemble de données textuelles. Une fois que des vecteurs ont été créés pour les mots ou les phrases du lexique, ils peuvent être utilisés pour identifier le sentiment ou l’émotion associés à d’autres mots ou phrases. Par exemple, si un mot ou une phrase est similaire à un vecteur de vocabulaire associé à un sentiment ou à une émotion particulière, on peut en déduire que le mot ou la phrase est également associé à ce sentiment ou à cette émotion (source : https://marketbrew.ai/word-embeddings-a-comprehensive-guide).

- Génération de contenu : les informations provenant des encastrements peuvent être utilisées pour générer de nouvelles phrases en rapport avec le texte original. Par exemple, si nous avons un texte sur les activités de plein air, le Word Embedding nous permet d’identifier les mots et expressions pertinents sur le sujet, tels que « camping », « vie en plein air », ce qui nous permettra d’améliorer le contenu de la page afin de la rendre plus pertinente par rapport à l' »intention de recherche » des activités de plein air. En plus de la génération d’un contenu complet, nous pouvons calculer la similarité sémantique d’une « requête » par rapport aux autres dans un vocabulaire(similarité cosinus) pour rendre notre contenu plus utilisable sans les entraves de la copie liées à sa simple fonction de référencement. Un cosinus élevé indique que les vecteurs sont similaires, tandis qu’un cosinus faible indique qu’ils sont différents et ne peuvent être considérés comme synonymes au niveau sémantique pour l’araignée.

- Prédiction contextuelle des mots: grâce à l’intégration, nous pouvons améliorer la précision de la fonction d’autocomplétion ou de texte prédictif. Les enchâssements capturent le contexte dans lequel les mots apparaissent et pourront donc être utilisés pour prédire le mot suivant sur la base des mots qui le précèdent, ce qui permettra de compléter automatiquement la recherche interne. Cette activité, associée à l’analyse toujours précieuse, via Google Analytics 4, des requêtes utilisées sur votre propre site web, nous permettra d’améliorer l’interface utilisateur de notre commerce électronique, par exemple, et de proposer la meilleure offre possible à l’acheteur potentiel.

Dans les guides précédents, nous nous sommes concentrés sur l’importance des analyses N-Gram, mais avec les embeddings, vous pouvez faire une mise à jour remarquable de l’information.

En termes d’efficacité SEO, les word embeddings présentent plusieurs avantages ; en premier lieu, ils permettent une compréhension moins approximative de la signification et du contexte des mots dans un document, ce qui peut être utile pour déterminer la pertinence et la qualité d’une page web, par rapport au traitement de l’analyse comme une fréquence d’entités individuelles qui reste valable pour l’architecture interne mais pas aussi spécifique que le scénario que nous décrivons. Les N-Grammes ne permettent pas non plus d’identifier les termes apparentés, ce qui réduit considérablement la puissance de l’analyse.

Screaming Frog, intégration et API ChatGpt

Avec la version 20 de Screaming Frog SEO Spider, les embeddings ont été introduits dans le Seo Spider généré à l’aide d’un modèle OpenAI et via l’API directement avec une fonction interne de l’outil.

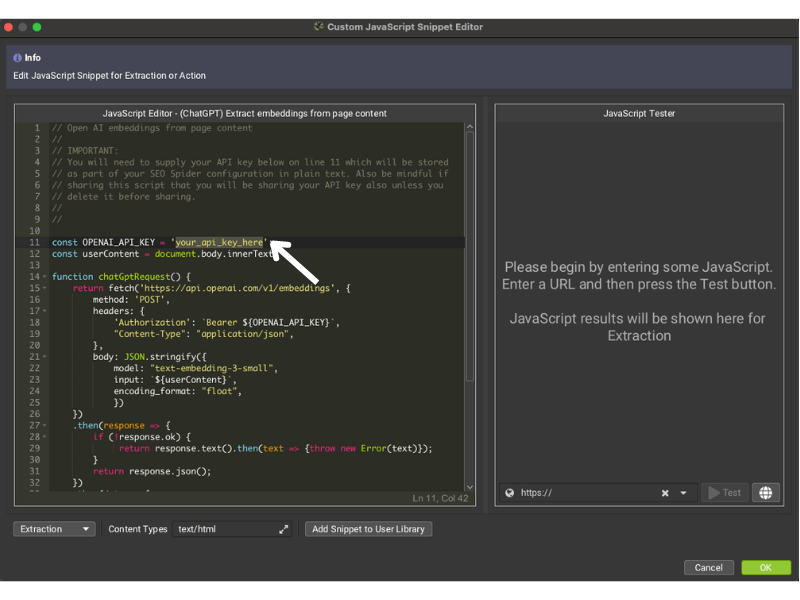

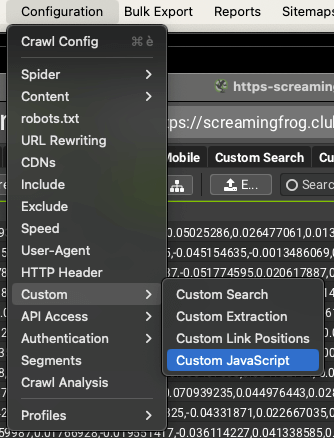

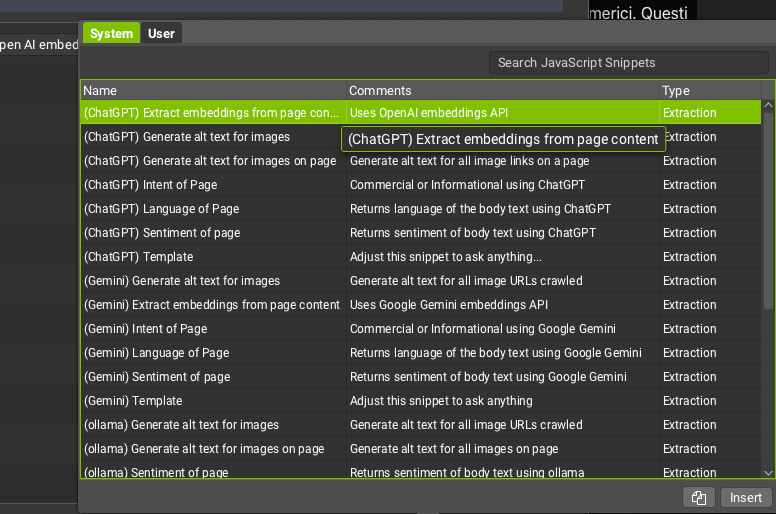

> Pour mettre en œuvre cette fonction, Screaming Frog a intégré la possibilité d’exécuter des fonctions JavaScript personnalisées, qui seront disponibles via la section Custom Custom JavaScript , où l’on peut choisir le script dédié et entrer la clé API OpenAI pour commencer à générer des embeddings pendant le balayage.

Une fois que vous avez choisi Custom Javascript, cliquez simplement sur« +Add from Library » et choisissez la première suggestion de Screaming Frog « (ChatGPT) Extract embeddings from page… ».

Cliquez sur l’icône « JS » pour modifier le script et insérer l’API générée avec OpenAI.

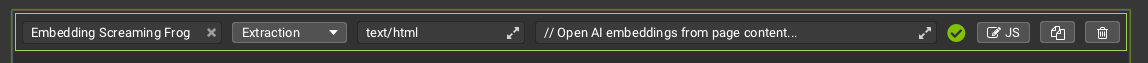

Vous trouverez ci-dessous l’écran dans lequel vous entrez votre clé API. Une fois copié et collé dans l’espace réservé, il suffit de traiter le scan avec Screaming Frog pour obtenir les embeddings. L’utilisation des API ayant un coût, il est conseillé d’utiliser le « Javascript Tester » en saisissant une URL à analyser afin d’avoir un aperçu du résultat possible d’une analyse complète.

Les résultats du « Custom Javascript » peuvent être lus dans l’onglet dédié en choisissant parmi les filtres si plusieurs extractions ou actions requises par le « Custom JS » sont actives.

S’il est nécessaire de partager l’analyse ou la configuration de Screaming Frog, il est nécessaire de supprimer l’API afin de ne pas fournir ces données. Des rumeurs communautaires ont déjà demandé aux développeurs de Screaming Frog d’obscurcir l’API une fois qu’elle est entrée afin de protéger ces données précieuses et coûteuses.

Mais maintenant que nous avons obtenu les embeds de Screaming Frog, comment pouvons-nous traiter nos nouvelles données ? Comme nous l’avons vu, les utilisations des embeddings sont nombreuses, examinons donc le processus permettant de trouver, à partir des vecteurs obtenus, une analyse très précise des pages apparentées.

Analyse des pages connexes

Un premier exemple d’application consisterait à comprendre les interconnexions entre les pages d’un site web ou entre les pages détaillées d’un commerce électronique afin d’offrir une expérience optimale au visiteur ou à l' »acheteur » potentiel.

Voyons comment :

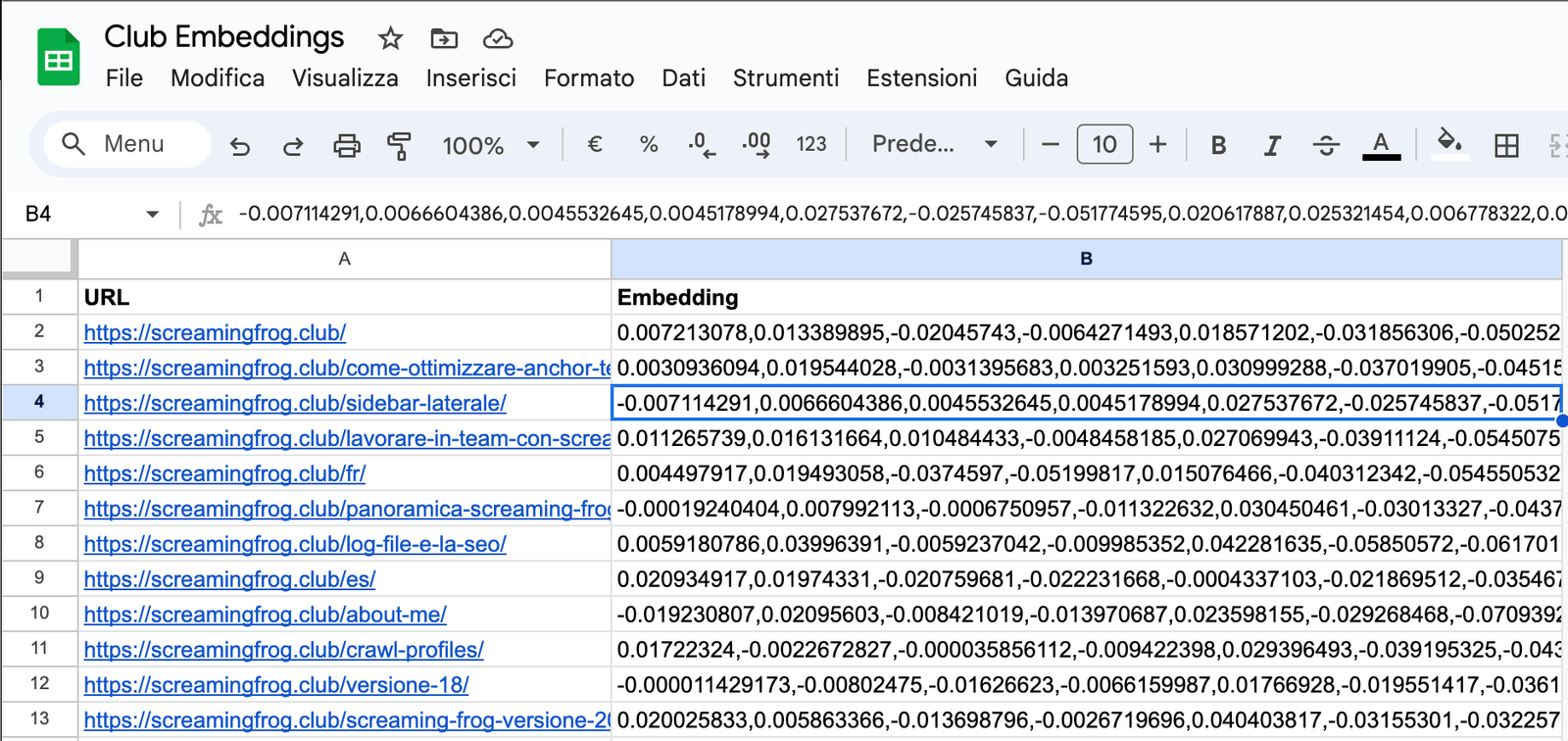

- J’obtiens les embeddings avec Screaming Frog.

- J’exporte les données de Seo Spider et je formate le fichier résultant en remplaçant « Adresse » par « URL ».

- Je supprime les colonnes « Code de statut » et « Statut ». Dans ce cas, vous n’aurez que deux en-têtes :

- URL.

- Les emboîtements.

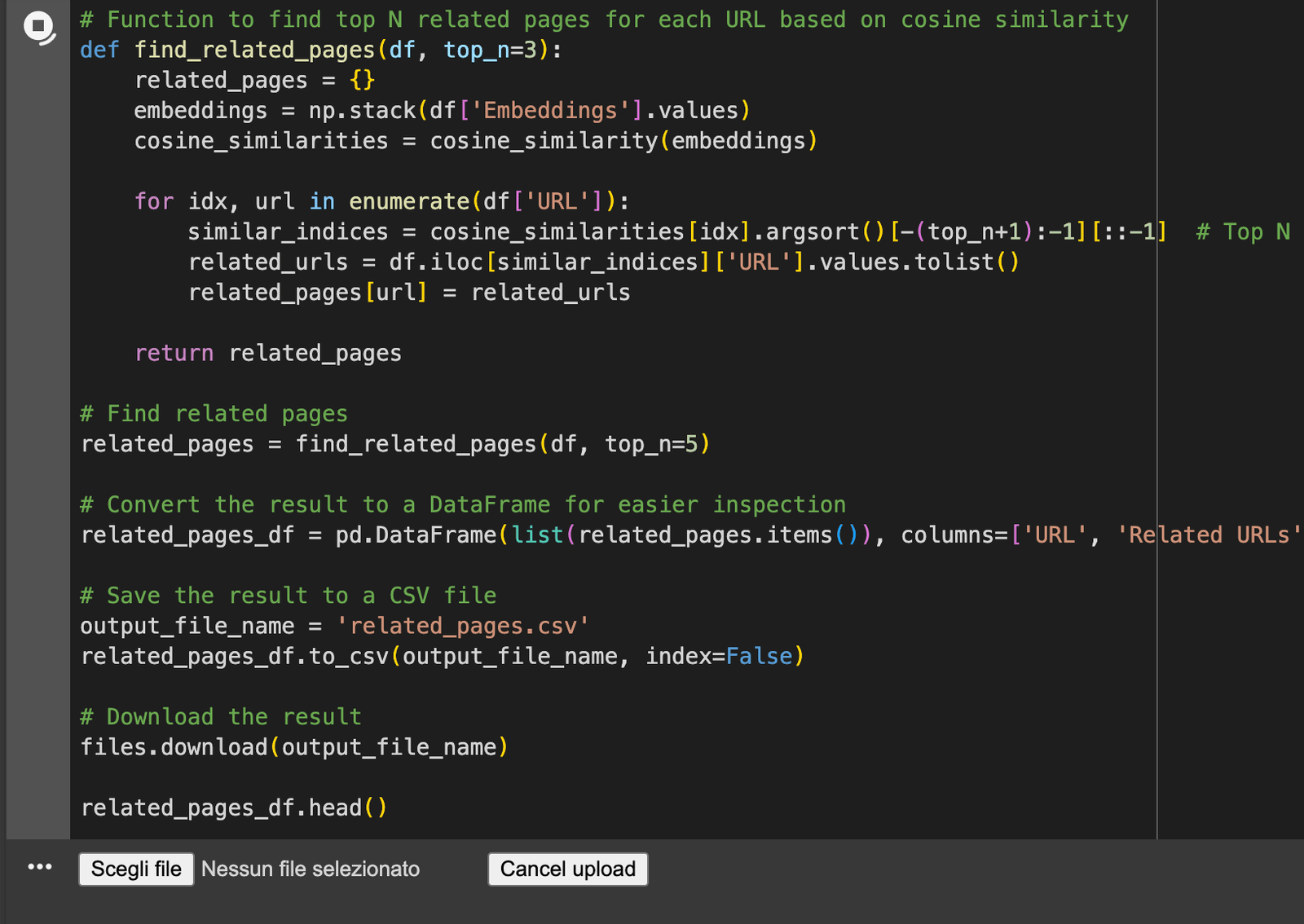

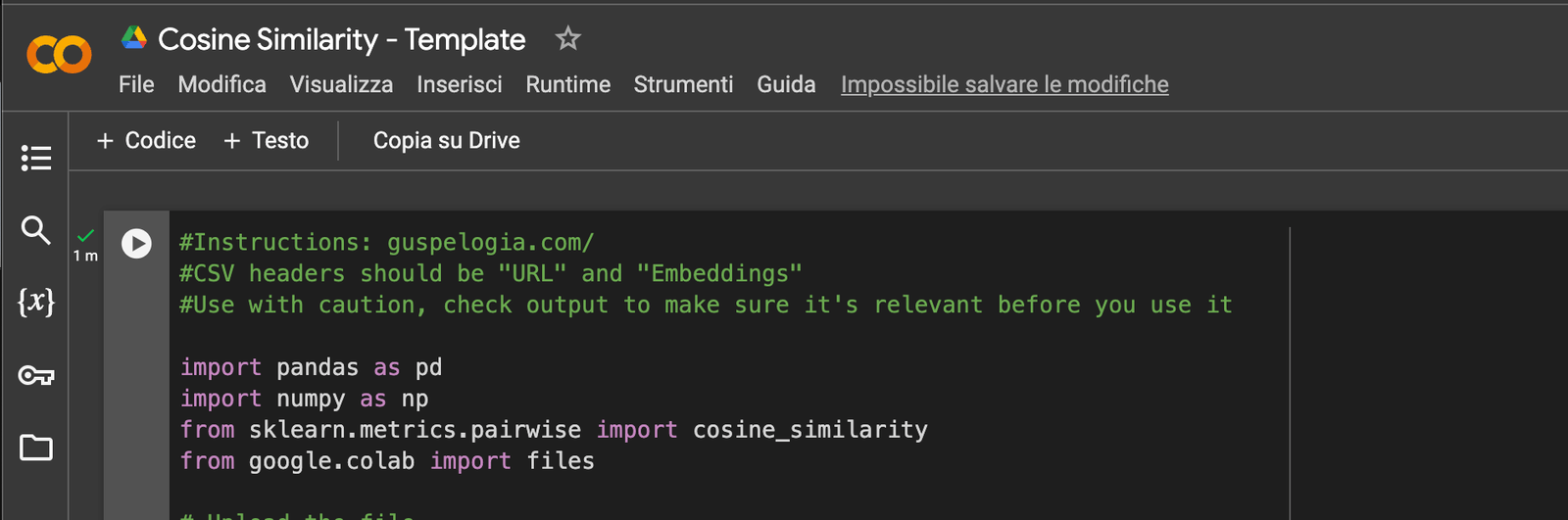

Vous pouvez maintenant utiliser un script Python sur Coleb pour traiter vos données. Vous trouverez ci-dessous un « script Gus Pelogia » à traiter.

L’outil vous demandera de télécharger votre fichier CSV (celui de Screaming Frog).

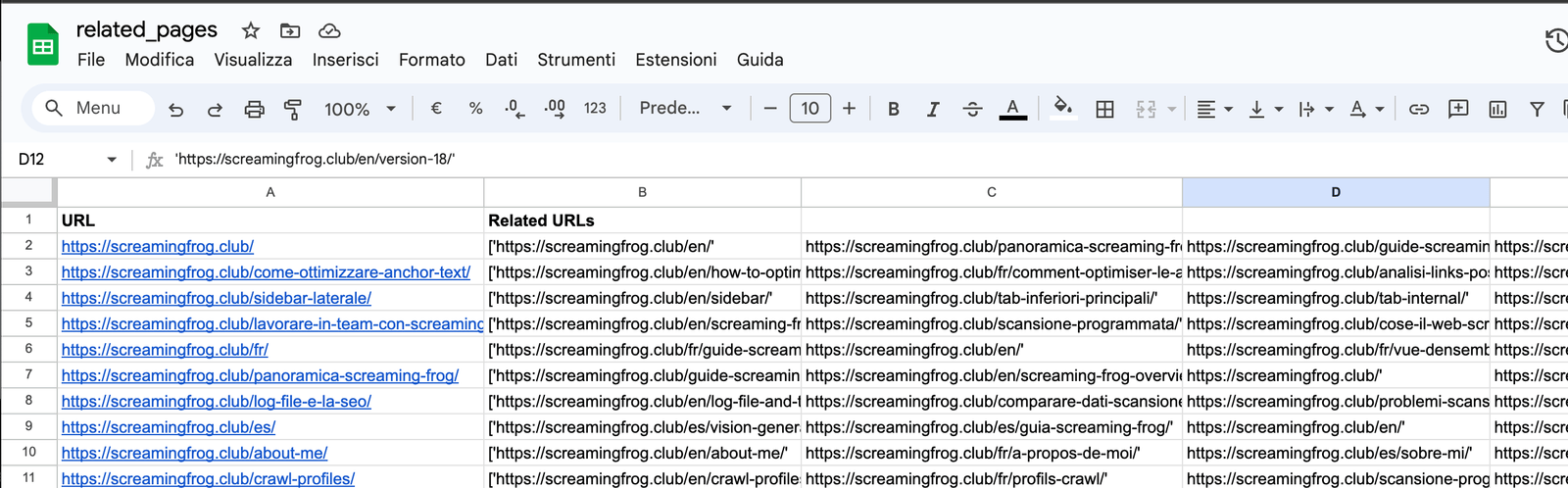

Une fois les données traitées, un autre fichier CSV sera automatiquement téléchargé avec les résultats classés en deux colonnes (si vous utilisez Google Spreadsheet, vous devrez tabuler les données en colonnes) :

- Source de la page.

- Pages connexes.

Cliquez simplement sur l’icône « Play » et Colab vous permettra de télécharger le fichier obtenu auprès de Screaming Frog.

À la fin du traitement, un nouveau fichier appelé« related_pages.csv » sera automatiquement téléchargé localement.

Il ne reste plus qu’à vérifier les résultats et à appliquer les changements corrects au site pour une « corrélation » optimale du contenu au niveau sémantique. Appliquée aux produits d’un commerce électronique, elle pourrait constituer une excellente stratégie pour améliorer le retour sur investissement et le panier moyen.

Regroupement

Pour le regroupement à l’aide d’encastrements, vous pouvez utiliser différents algorithmes de regroupement tels que K-means ou DBScan , qui utilisent différentes mesures de similarité pour créer des groupes homogènes. Pour créer un script, j’ai utilisé les bibliothèques ‘pandas’ pour la manipulation des données, ‘sklearn’ pour le clustering et ‘matplotlib + seaborn’ pour l’affichage d’une image et d’un document de sortie en csv. Le fichier que j’ai utilisé comme ensemble de données était formaté comme le précédent avec deux colonnes « URLs » et « Embeddings ».